Toda esta historia comienza con un papel que fue publicado por investigadores de UC Berkeley el 22 de agosto de 2018, demostrando cómo una computadora puede superponer un «esqueleto digital» a la semejanza de un ser humano para hacer que la persona parezca un buen bailarín. Suena divertido, ¿verdad?

¿Quién de nosotros con dos pies izquierdos no querría presentar un video de nosotros mismos bailando como el próximo Michael Jackson? Sin embargo, el hecho de que estemos mezclando inteligencia artificial con software de edición y renderizado de video podría tener algunas implicaciones bastante siniestras si se abusa de la tecnología.

Presentación del trabajo de los investigadores

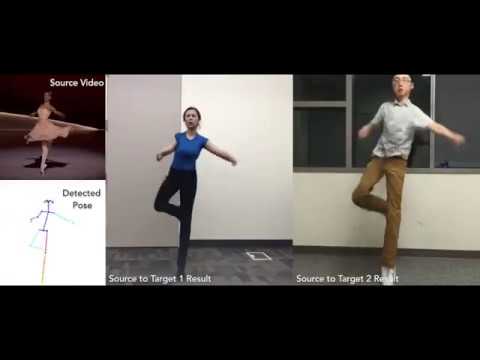

El artículo publicado por los investigadores que se mencionó anteriormente fue básicamente una demostración de cómo se podría emplear el aprendizaje automático para «transferir movimiento entre sujetos humanos en diferentes videos», superponiendo efectivamente los movimientos de una persona a otra. Puedes ver los resultados de su trabajo aquí:

Parece tonto y algo divertido, pero las realidades que podríamos enfrentar a medida que dicha tecnología continúa desarrollándose podrían ser un desafío para nosotros como sociedad en el futuro. Aunque estamos usando el término «IA» vagamente al decir que esta es una demostración de una técnica de edición de video que implementa el concepto, ciertamente es uno de los precursores de la inteligencia artificial (por ejemplo, «imaginar» a alguien en una situación) .

Hablemos de las falsificaciones profundas

Use «deepfake» como término de búsqueda en YouTube y encontrará muchos videos amigables para el trabajo que presentan intercambios de rostros de celebridades y algunas falsificaciones poco convincentes producidas en el acto. Aunque esto suele hacerse de buen humor, no todo el mundo tiene buenas intenciones con este software.

Deepfakes toma un perfil facial de un individuo y lo superpone sobre el rostro de otro individuo. Puedes ver a dónde vamos con esto, y si no puedes, aquí está: hay muchas personas que usan esta técnica para crear un video de «porno de venganza» de otros, implicándolos en una situación muy intimidante en la que encontrar su imagen adjunta a contenido explícito y no tener ningún recurso. Parece que hicieron lo que sea que está pasando en el video.

Una tecnología de superposición más avanzada podría permitir que las computadoras dibujen un esqueleto virtual que luego permitiría a los actores maliciosos superponer a una persona completa en una situación potencialmente comprometedora. Terminamos con un cóctel de herramientas que podrían usarse para fabricar evidencia. Se podría hacer que un tirador se pareciera a otra persona en las imágenes de la escena del crimen.

¿Qué efecto tendría esto legalmente?

La mayoría de los países ya cuentan con un sistema legal que define claramente la falsificación de hechos o un falso testigo. En lo que respecta a la «suplantación virtual» de un individuo, el uso de estas técnicas para modificar un video ya está dentro del alcance de estas leyes.

Donde las cosas se complican es cuando se trata de que los tribunales admitan evidencia en video. Si tenemos la tecnología para manipular videos en la medida en que lo hacemos ahora, imagine lo que seríamos capaces de hacer dentro de cinco años. ¿Cómo podría un tribunal considerar confiable el video presentado? No es muy difícil hacer que un duplicado actúe exactamente como un original. Después de todo, todo es digital.

Los tribunales de justicia ya son muy reacios a aceptar evidencia en video en sus archivos de casos. Esta progresión de la tecnología en realidad puede llevarlos al límite, hasta el punto en que no pueden confiar en nada de lo que fue capturado en video por temor a aceptar algo que está manipulado.

Al final, nos guste o no, parece que este nuevo tipo de tecnología está aquí para quedarse con nosotros y tendremos que adaptarnos en consecuencia. Uno de los primeros pasos que podríamos tomar es crear conciencia sobre el hecho de que los videos se pueden falsificar mucho más fácilmente, y con muchos menos recursos y requisitos de habilidades, que en los años 80. Eventualmente, las personas serán más escépticas sobre los videos que ven.

“La tecnología solo se está volviendo más y más avanzada… La gente se va a asustar. Y simpatizo sinceramente con ellos. Pero como la tecnología no se puede desinventar, tenemos que avanzar con ella. Soy mucho más partidario del algoritmo de falsificaciones profundas en sí mismo y su potencial en lugar de para lo que se está utilizando actualmente. Pero, de nuevo, bienvenido a Internet”.

Esto es lo que un usuario particular de Reddit le dijo a The Verge en un artículo publicado en febrero de 2018.

¿Cómo crees que deberíamos difundir la conciencia? ¿Qué más debemos hacer para adaptarnos? ¡Tengamos esta discusión en los comentarios!